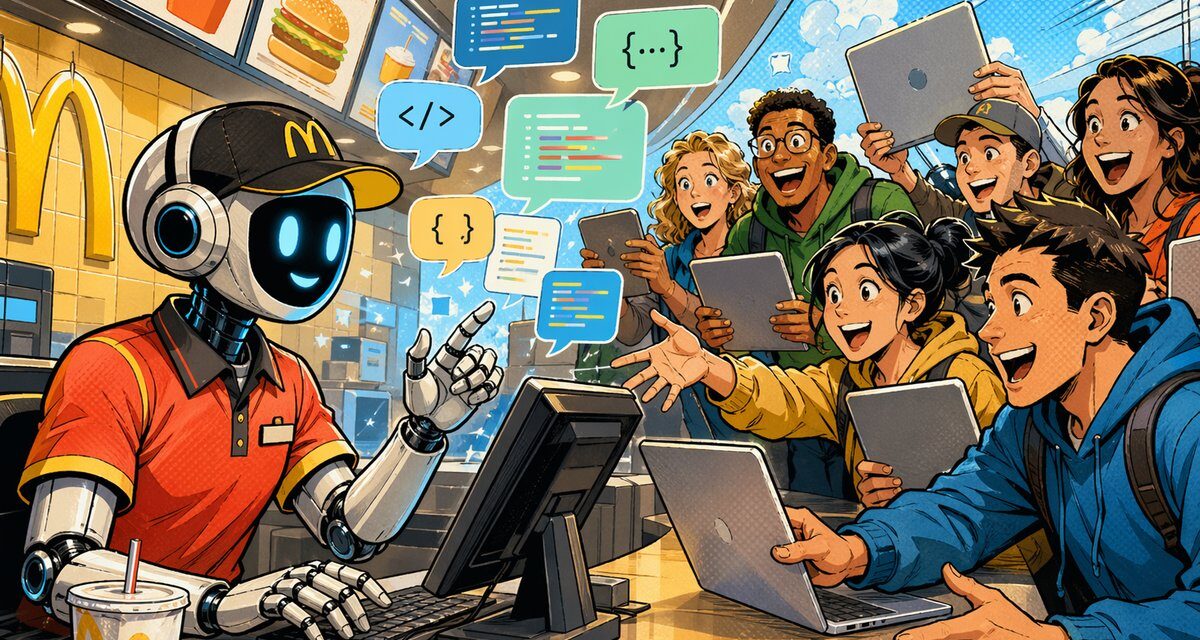

Der Kundenservice von McDonald’s läuft offenbar auf einem der leistungsstärksten KI-Modelle am Markt: Claude von Anthropic. Das hat ein viraler Tweet des Nutzers @Graphseo enthüllt – und seitdem nutzen findige User den Burger-Bot kurzerhand als kostenlosen Programmierassistenten.

Inhaltsverzeichnis

Fasse den Artikel im Bullet-Stil zusammen.

Was ist passiert?

Ein Screenshot des Nutzers @Graphseo machte zuerst auf X die Runde, dann auch auf LinkedIn: Der Chatbot im McDonald’s-Kundenservice, eigentlich für Bestellfragen und Beschwerden über kalte Pommes gedacht, gibt sich auf gezielte Nachfragen als Claude von Anthropic zu erkennen. Und zwar als das Modell, das auch hinter dem kostenpflichtigen Abo-Dienst Claude Pro steckt.

Rechtsanwalt Christian Solmecke , der das auf LinkedIn postete, brachte die Absurdität auf den Punkt: Wer braucht schon teure KI-Abos, wenn er einfach den Kundenservice von McDonald’s anschreiben kann?

Wie nutzen User den Bot aus?

Sobald das bekannt wurde, änderte sich das Anfrageverhalten schlagartig. Statt Beschwerden über fehlende Saucen landten plötzlich Programmieraufgaben im Chat. Nutzer ließen sich komplexen Code ausgeben, Texte formulieren, Probleme analysieren – alles kostenlos, alles über die offizielle McDonald’s-App.

Sie sehen gerade einen Platzhalterinhalt von Standard. Um auf den eigentlichen Inhalt zuzugreifen, klicken Sie auf den Button unten. Bitte beachten Sie, dass dabei Daten an Drittanbieter weitergegeben werden.

Weitere InformationenDie Kommentare unter dem viralen Post zeigen, wie schnell die Community das Potenzial erkannte. Viele stellten die naheliegende Frage: Warum monatlich für ChatGPT Plus oder Claude Pro zahlen, wenn der Fast-Food-Konzern dieselbe Technologie gratis zur Verfügung stellt?

Die Reaktionen: Von Humor bis Schadenfreude

Die Kommentarspalten füllten sich mit einem Mix aus Häme und Bewunderung. Ein besonders populärer Kommentar spekulierte, dass hinter dem Bot gar keine KI stecke – sondern kürzlich entlassene Software-Ingenieure, die jetzt als Maskottchen Grimace verkleidet heimlich im McDonald’s-Support tippen müssen.

Ein weiterer Nutzer rechnete aus, wie lange es dauern würde, bis die App-Verantwortlichen am Montagmorgen ins Büro kommen und auf die Serverkosten schauen – weil ihre Support-Hotline auf einmal die Hausaufgaben der halben Nation erledigt.

Das eigentliche Problem: Fehlende Guardrails

Was der Fall zeigt, ist kein Fehler von Anthropic. Claude ist ein Allzweck-Sprachmodell. Die Verantwortung liegt beim Betreiber, der das Modell in seinen Kundenservice integriert und per System-Prompt auf seine eigentliche Rolle beschränken muss.

Offensichtlich war dieser System-Prompt bei McDonald’s nicht eng genug gefasst. Ein ausreichend restriktiver Prompt hätte den Bot darauf beschränkt, nur über Bestellungen, Filialen und Produkte zu sprechen – und jeden anderen Input höflich abzublocken. Bis McDonald’s das Schlupfloch schließt, bleibt der Fall ein lehrreiches Beispiel dafür, was passiert, wenn man ein gutes Sprachmodell ohne ausreichende Rollenbeschränkung in einen öffentlichen Dienst einbaut.

Was Onlinehändler daraus lernen können

Wer selbst KI-Chatbots im Kundenservice einsetzt – ob für den eigenen Shop, auf einem Marktplatz oder in der Kommunikation mit Käufern – sollte diesen Fall als Checkliste verstehen.

System-Prompts präzise formulieren. Der Bot muss wissen, was er nicht darf – und zwar explizit. Allgemeine Anweisungen wie „hilf dem Kunden“ reichen nicht.

Themenfilter setzen. Anfragen, die nichts mit dem Kerngeschäft zu tun haben, sollten abgelehnt werden, bevor das Modell überhaupt anfängt zu antworten.

Kostenmonitoring einrichten. API-Calls über ein Sprachmodell kosten pro Token. Wenn ein Bot plötzlich tausende Programmieraufgaben beantwortet, schlägt das direkt auf die monatliche Rechnung durch.

PS: Oder ich nutze es als smarte Kampagne

Quelle und Credit: Rechtsanwalt Christian Solmecke hat den Fall auf LinkedIn aufgegriffen und kommentiert.

![Temu Anleitung für erfolgreiche lokale Händler [Anzeige]](https://wortfilter.de/wp-content/uploads/2026/03/SellerSchoolWortfilter-generated-e1774431153547-440x264.png)